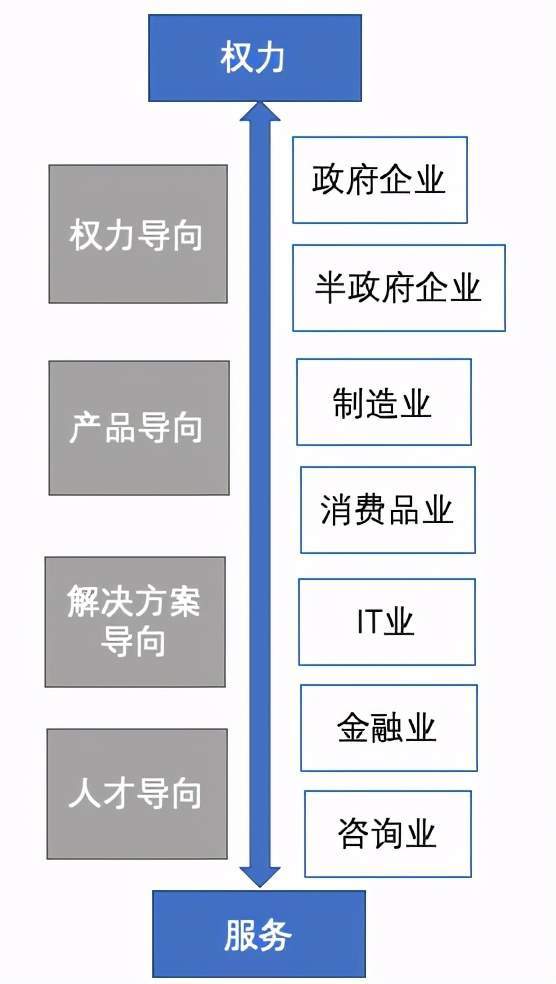

在當今數字化浪潮中,企業資源計劃(ERP)系統已成為現代企業管理不可或缺的核心工具。其中,ERP人力資源管理模塊不僅將傳統的人事管理事務電子化,更通過深度整合業務流程與數據,重塑了人力資源服務的模式與價值。其實務應用,正推動著人力資源部門從成本中心向戰略合作伙伴的轉型。

一、ERP人力資源管理的核心實務領域

ERP人力資源管理實務涵蓋員工信息管理、招聘與配置、薪酬福利、績效管理、培訓發展、考勤與排班等全生命周期流程。通過一個統一的數據庫平臺,它確保了人力資源數據的準確性、一致性和實時性,為管理決策提供了可靠依據。例如,在招聘環節,系統可以自動發布職位、篩選簡歷、安排面試,并與后續的入職、合同簽訂流程無縫銜接,極大地提升了效率。

二、對人力資源服務的深刻變革

傳統的人力資源服務往往局限于事務性處理,而ERP的引入帶來了質的飛躍。

- 服務效率提升:自動化處理大量重復性工作,如薪資計算、社保申報、考勤統計等,解放HR從事務性工作中脫身。

- 數據驅動決策:系統可生成多維度的分析報表,如人才結構分析、離職率分析、培訓效果評估等,為人才戰略規劃、組織優化提供精準的數據洞察。

- 員工自助服務:通過員工門戶,員工可自主查詢薪資條、申請休假、更新個人信息、報名培訓等,提升了服務體驗與透明度,也減輕了HR的溝通負擔。

- 流程合規與標準化:系統固化了企業的人力資源管理制度與流程,確保各項操作符合法律法規與內部政策,降低了合規風險。

三、實施與應用的關鍵實務要點

成功實施ERP人力資源管理模塊,需關注以下實務關鍵:

- 需求分析與流程再造:實施前必須梳理并優化現有流程,確保系統配置貼合企業實際管理需求,而非簡單照搬舊流程。

- 數據質量與遷移:歷史數據的清洗、標準化與準確遷移是系統成功運行的基石。

- 系統集成:確保HR模塊與ERP中的財務、生產、銷售等模塊無縫集成,實現業務流與人才流、數據流的貫通,發揮最大協同價值。

- 變革管理與培訓:系統上線涉及工作習慣改變,需通過有效的變革溝通和持續培訓,推動管理層與員工接受并熟練使用新系統。

- 持續優化與迭代:系統上線不是終點,應根據業務發展和管理需求,不斷優化功能與流程。

四、未來展望:智能化與人性化融合

隨著人工智能、大數據等技術的發展,未來的ERP人力資源管理將更加智能化。例如,利用AI進行簡歷智能匹配、員工離職風險預測、個性化學習路徑推薦等。技術始終是工具,人力資源服務的核心仍在于“人”。未來的實務重點將是如何利用ERP這一強大引擎,更好地服務于員工成長、激發組織活力,最終實現企業與員工的共同發展。

ERP人力資源管理實務的深化,是人力資源服務走向精細化、戰略化、數字化的必然路徑。它不僅是技術的應用,更是一場管理理念與服務的升級。企業只有將其融入組織血脈,才能真正釋放人力資源的戰略價值,在激烈的市場競爭中贏得人才優勢。